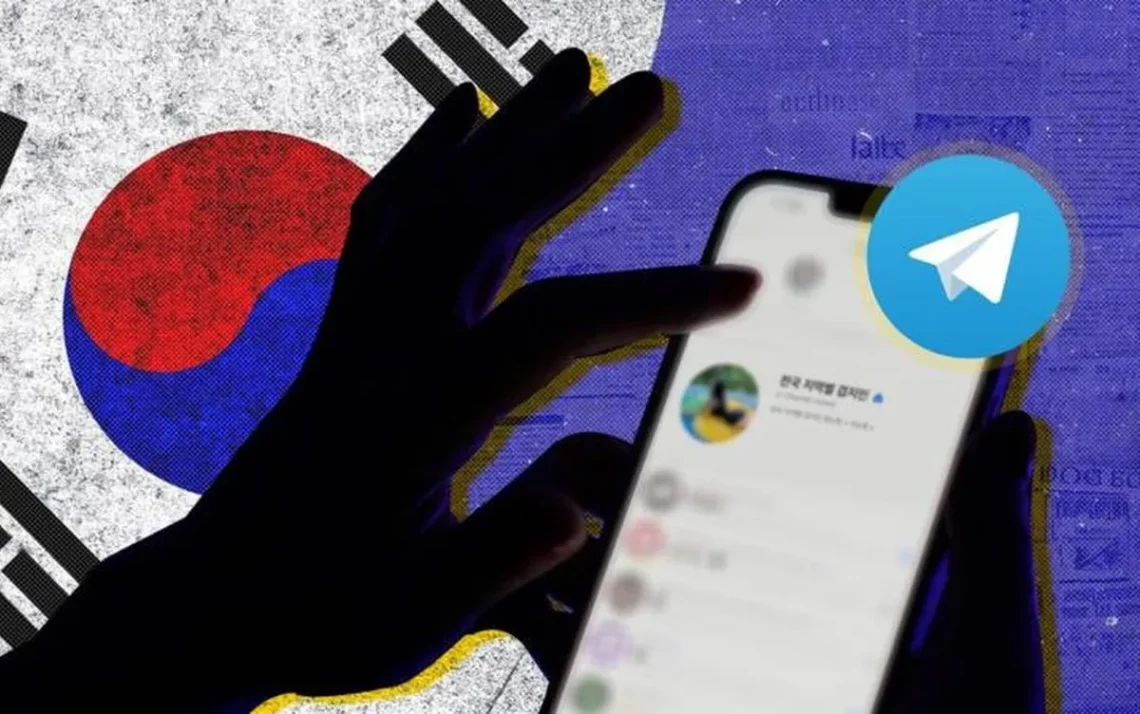

Escândalo abrange mais de 500 instituições de ensino e várias vítimas menores; mensagens pessoais e deepfake em grupos do Telegram.

No último sábado (31/8), Heejin recebeu uma mensagem no Telegram de um remetente desconhecido, alertando sobre um vazamento de suas informações pessoais. A mensagem dizia: ‘Suas fotos e informações pessoais vazaram.’ A situação gerou preocupação, especialmente em um mundo onde a pornografia e as deepfakes estão se tornando cada vez mais comuns.

Além do vazamento, Heejin ficou alarmada ao perceber que suas imagens poderiam ser utilizadas para criar deepfakes pornográficos. A possibilidade de ver suas fotos manipuladas em conteúdos pornográficos e falsos a deixou angustiada. É fundamental estar ciente dos riscos associados a essas tecnologias.

O Impacto da Pornografia Deepfake

Quando a estudante universitária da Coreia do Sul entrou no bate-papo para ler a mensagem, ela se deparou com uma foto sua, capturada alguns anos atrás, quando ainda estava na escola. Em seguida, recebeu uma segunda imagem que utilizava a mesma foto, mas de forma sexualmente explícita — e claramente falsa. Apavorada, Heejin, que não é seu nome verdadeiro, decidiu não responder, mas as imagens continuaram a chegar. Em todas elas, seu rosto foi anexado a um corpo realizando atos sexuais, utilizando a avançada tecnologia de deepfake. A pornografia deepfake — que, em sua essência, combina o rosto de uma pessoa real com um corpo falso e pornográfico — está se tornando cada vez mais comum, gerada por meio de ferramentas de inteligência artificial.

Compreendendo o Deepfake e suas Implicações

O trauma devastador que acompanha quem tem sua imagem utilizada em deepfakes pornográficos é inegável. ‘Fiquei petrificada, me senti tão sozinha’, relatou Heejin à BBC. No entanto, ela não estava sozinha nessa situação angustiante. Apenas dois dias antes, a jornalista sul-coreana Ko Narin havia publicado o que se tornaria o maior furo de reportagem de sua carreira. Recentemente, foi revelado que a polícia estava investigando redes de pornografia deepfake em duas das principais universidades do país, e Ko acreditava que havia muito mais a ser descoberto.

Ela começou a investigar nas redes sociais e encontrou dezenas de grupos de bate-papo no aplicativo de mensagens Telegram, onde os usuários compartilhavam fotos de mulheres que conheciam e utilizavam um software de inteligência artificial para transformá-las em imagens pornográficas falsas em questão de segundos. ‘A cada minuto, as pessoas estavam enviando fotos de garotas que conheciam, pedindo que fossem convertidas em deepfakes’, disse Ko à BBC.

Grupos de Bate-Papo e a Cultura do Deepfake

Ko descobriu que esses grupos não se limitavam a estudantes universitárias. Existiam salas de bate-papo dedicadas a escolas específicas do ensino médio e até mesmo do ensino fundamental. Se um número excessivo de conteúdos fosse criado utilizando as imagens de uma aluna em particular, ela poderia até ganhar sua própria sala. Comumente rotuladas como ‘salas de humilhação’ ou ‘salas de amigas de amigos’, essas comunidades geralmente impõem termos de entrada rigorosos.

A reportagem de Ko, publicada no jornal Hankyoreh, chocou a sociedade sul-coreana. Na segunda-feira (2/9), a polícia anunciou que estava considerando abrir uma investigação sobre o Telegram, seguindo o exemplo das autoridades na França, que recentemente acusaram o fundador do aplicativo de crimes relacionados à plataforma. O governo se comprometeu a impor punições mais severas para os envolvidos, e o presidente pediu que os jovens fossem mais educados sobre o uso responsável da tecnologia.

A Resposta do Telegram e a Luta Contra a Pornografia Ilegal

O Telegram, por sua vez, afirmou que ‘combate ativamente conteúdo prejudicial em sua plataforma, incluindo pornografia ilegal’, em uma declaração enviada à BBC. LEIA TAMBÉM: ‘Fui colocada em deepfake pornô pelo meu melhor amigo.’ A BBC teve acesso a descrições de várias dessas salas de bate-papo. Uma delas exige que os membros postem mais de quatro fotos de alguém, junto ao nome, para que possam ser transformadas em deepfakes.

Fonte: © G1 – Tecnologia

Comentários sobre este artigo